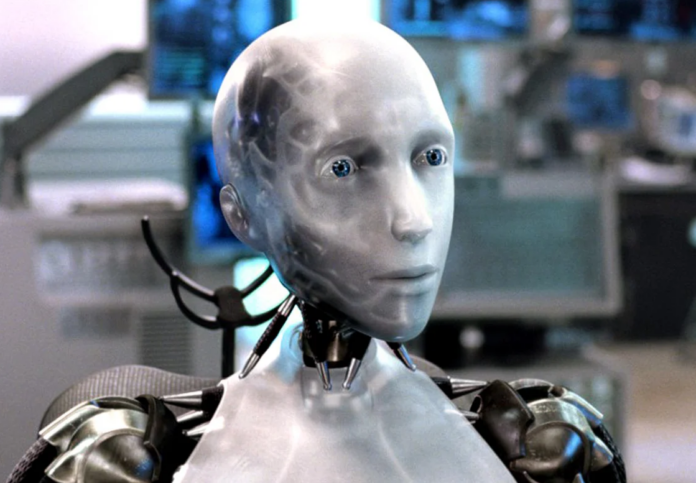

C’è già chi parla di un’intelligenza artificiale che prenderà il sopravvento sull’uomo; altri sono molto più scettici. In ogni caso, ChatGPT è al centro dell’attenzione

ChatGPT è un chatbot lanciato da OpenAI: fondamentalmente, un’intelligenza artificiale capace di conversare realisticamente, simulando argomenti e discussioni tramite un complesso sistema di computing di dati studiato per comporre stringhe di parole con significati specifici, creando cioè un linguaggio.

Direte: va bene, ma è quello che fanno i normali bot pubblicitari o alcune delle I.A. che si occupano di comunicazione con il pubblico per le aziende. Sì, ma sembra che ChatGPT si possa spingere ben oltre: non solo simulando frasi, discussioni e conversazioni con parole e termini contestualizzati, ma anche (ovviamente) attingendo ad un vasto corpus di conoscenze che la rendono preparatissima.

OpenAI ha rilasciato il bot lo scorso novembre e in una mossa rivoluzionaria ha anche aperto un’interfaccia che consente agli utenti di interagire subito con esso e di sperimentarne le varie possibilità di linguaggio. Che sono davvero tante, dalla risoluzione di problemi di codifica alla creazione di messaggi da inviare a partner o colleghi.

E come sempre, quando si parla di innovazioni di questo tipo, il pubblico è diviso: c’è chi si entusiasma di fronte alle infinite possibilità di macchine e circuiti che possono sostituire gli umani in lavori o attività tediose con uguale se non superiore capacità espressiva; e c’è chi, proprio a fronte di questo, paventa l’avvento delle I.A. imminente e l’estinzione della nostra razza.

Diciamo che, per quanto ChatGPT mostri davvero potenzialità incredibili rispetto ai suoi predecessori e di certo infinitamente alte rispetto al bot medio, entrambi gli scenari sopra descritti sono ancora di là da venire. Come si dice: mettendo insieme un numero infinito di scimmie, prima o poi si otterrà Shakespeare. Ecco, qui diciamo che ci sono tante, tante scimmie; ma a Shakespeare ancora non ci siamo.

Lo afferma la stessa OpenAI, dicendo: “ChatGPT a volte scrive risposte che suonano plausibili ma sono incorrette o senza senso“. In compenso altri esempi illustrati sul sito mostrano come ChatGPT sia studiato per evitare l’espressione di contenuti violenti, incitare al bullismo o aggirare informazioni enciclopedicamente non corrette.

I problemi comunque si pongono e spuntano fuori quando lo strumento viene utilizzato per creare contenuti come per esempio articoli online. Un giornalista della nostra fonte, Insider, ci ha provato (qui) e afferma che ChatGPT ha svolto un lavoro pressoché perfetto, con la pecca di aver inventato di sana pianta quote attribuite al CEO di un’azienda, che erano perciò assolutamente false.

Di fatto già nel 2019 OpenAI avvisava: “Attori maliziosi potrebbero essere motivati dal perseguimento del guadagno di denaro, una particolare agenda politica e/o dal desiderio di creare caos o confusione [nell’utilizzo di ChatGPT]”. E di esempi simili, nella creazione di contenuti e articoli online, ne abbiamo avuti a iosa durante i mesi e gli anni della pandemia.

Il fatto che la scrittura di ChatGPT sia assolutamente convincente ed elimini potenzialmente qualunque componente “morale” e umana di discernimento favorisce la disinformazione, che a quel punto dipenderà dall’input umano stesso. Sarebbe a dire: come tutti gli strumenti, ChatGPT potrebbe essere pericoloso o nocivo ma solo in base all’uso che se ne farà; o a chi, insomma, lo userà.

Fonte: Insider

Continuate a seguirci su LaScimmiaPensa

![Hayao Miyazaki contro l’arte generata da I.A.: “Sono completamente disgustato” [VIDEO] Miyazaki](https://www.lascimmiapensa.com/wp-content/uploads/2025/03/image-303-218x150.png)

![I Meme più famosi rifatti dalla I.A. in stile Studio Ghibli sono uno spettacolo [FOTO] Meme](https://www.lascimmiapensa.com/wp-content/uploads/2025/03/image-291-218x150.png)

![Elon Musk: Grok 3 ha una modalità “por*o” e gli utenti stanno impazzendo [FOTO] Grok](https://www.lascimmiapensa.com/wp-content/uploads/2025/02/image-269-218x150.png)

![Cina: robot I.A. va fuori controllo e tenta di aggredire la folla, il video è virale [VIDEO] robot](https://www.lascimmiapensa.com/wp-content/uploads/2025/02/image-264-218x150.png)

![Donna ingannata da un Brad Pitt I.A.: l’inganno le porta via 830mila dollari [FOTO] Brad](https://www.lascimmiapensa.com/wp-content/uploads/2025/01/image-118-218x150.png)